eTamu.id – Meta telah mengumumkan inisiatif baru yang bertujuan untuk menetapkan parameter-parameter yang disepakati seputar pertimbangan keamanan siber dalam pengembangan large language models (LLMs) dan alat AI generatif, yang diharapkan akan diadopsi oleh industri secara luas, sebagai langkah kunci untuk memfasilitasi keamanan AI yang lebih besar.

Dikenal sebagai “Purple Llama”, berdasarkan Llama LLM mereka sendiri, proyek ini bertujuan untuk “menggabungkan alat-alat dan evaluasi untuk membantu komunitas membangun secara bertanggung jawab dengan model AI generatif terbuka.”

Menurut Meta, proyek Purple Llama bertujuan untuk menetapkan rangkaian evaluasi keamanan siber yang berlaku di seluruh industri untuk LLMs.

Baca juga: Meta Membawa Fitur Baru “Inbox Notes†ke Aplikasi Messenger

Menurut Meta:

“Benchmark ini didasarkan pada panduan dan standar industri (misalnya, CWE dan MITRE ATT&CK) dan dibangun dalam kolaborasi dengan para ahli keamanan kami. Dengan rilis awal ini, kami bertujuan untuk menyediakan alat yang akan membantu mengatasi sejumlah risiko yang tercantum dalam komitmen Casa Putih tentang pengembangan AI yang bertanggung jawab.”

Direktif keselamatan AI terbaru Casa Putih mendorong pengembang untuk menetapkan standar dan pengujian untuk memastikan bahwa sistem AI aman, untuk melindungi pengguna dari manipulasi berbasis AI, dan pertimbangan lain yang idealnya dapat menghentikan sistem AI dari menguasai dunia.

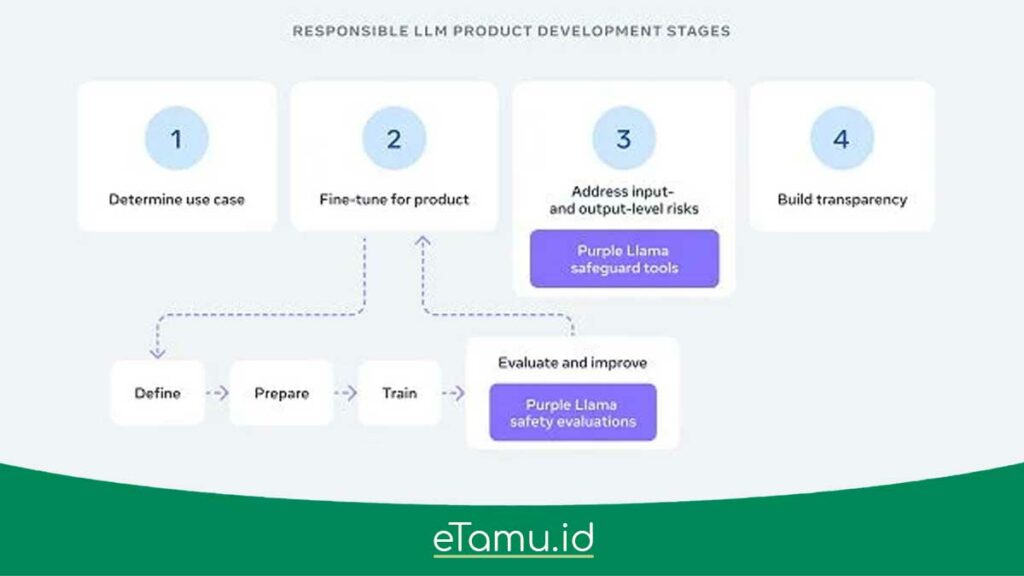

Apa saja parameter utama yang mendorong proyek Purple Llama Meta, yang awalnya akan mencakup dua elemen kunci:

- Evaluasi CyberSec – Benchmark evaluasi keamanan siber yang disepakati industri untuk LLMs

- Llama Guard – Kerangka kerja untuk melindungi dari keluaran AI yang berpotensi berisiko.

“Kami percaya bahwa alat-alat ini akan mengurangi frekuensi LLMs yang menyarankan kode AI yang tidak aman dan mengurangi kebermanfaatannya bagi lawan siber. Hasil awal kami menunjukkan bahwa ada risiko keamanan siber yang berarti untuk LLMs, baik dengan merekomendasikan kode yang tidak aman maupun untuk mematuhi permintaan yang jahat.”

Purple Llama akan bermitra dengan anggota Aliansi AI yang baru terbentuk yang Meta bantu pimpin, dan juga melibatkan Microsoft, AWS, Nvidia, dan Google Cloud sebagai mitra pendiri.

Lalu, apa hubungannya dengan “ungu”? Saya bisa menjelaskannya, tapi itu cukup nerdy, dan segera setelah Anda membacanya, Anda akan menyesal telah menyimpan pengetahuan itu dalam pikiran Anda.

Keselamatan AI dengan cepat menjadi pertimbangan kritis, seiring evolusi model AI generatif dengan kecepatan yang cepat, dan para ahli memperingatkan bahaya dalam membangun sistem yang pada akhirnya bisa “berpikir” sendiri.

Itu sudah lama menjadi ketakutan para pecinta fiksi ilmiah dan penganut kehancuran AI, bahwa suatu hari nanti, kita akan menciptakan mesin yang bisa memikirkan hal-hal di luar pemahaman sederhana otak manusia kita, secara efektif membuat manusia menjadi usang, dan membentuk spesies dominan baru di planet ini.

Kita masih jauh dari hal tersebut menjadi kenyataan, tetapi seiring perkembangan alat AI, ketakutan-ketakutan tersebut juga tumbuh, dan jika kita tidak sepenuhnya memahami sejauh mana keluaran-keluaran yang mungkin dari proses-proses semacam itu, bisa jadi akan ada masalah yang signifikan dari perkembangan AI.

Namun demikian, jika pengembang di AS melambatkan kemajuannya, itu tidak berarti bahwa peneliti di pasar lain akan mengikuti aturan yang sama. Dan jika pemerintah-pemerintah Barat menghambat kemajuan, itu juga bisa menjadi ancaman eksistensial, karena pesaing militer potensial membangun sistem AI yang lebih canggih.

Jawabannya, sepertinya, adalah kolaborasi industri yang lebih besar dalam hal langkah-langkah keselamatan dan peraturan, yang kemudian akan memastikan bahwa semua risiko yang relevan sedang dievaluasi dan diperhitungkan.

Proyek Purple Llama Meta adalah langkah lain dalam jalur ini.

Baca juga:

- Tantangan Meta: Moderasi Konten & Perlindungan Pengguna Muda!

- Auto Like IG (Instagram) 1000 Gratis Indonesia Tanpa Password

- Cara Menambah Followers Threads di Instagram Secara Gratis

- Download Snap IG (Instagram) Video Tanpa Perlu Aplikasi di HP

- Download Aplikasi Live Plus Plus Paling Bebas Bar Bar Versi Mod - May 14, 2026

- ✓ 10 Tips Cara Menambah Followers Gratis dengan Cepat - May 13, 2026

- Musicallydown Apk Tiktok Downloader Tanpa Iklan & Watermark - May 13, 2026